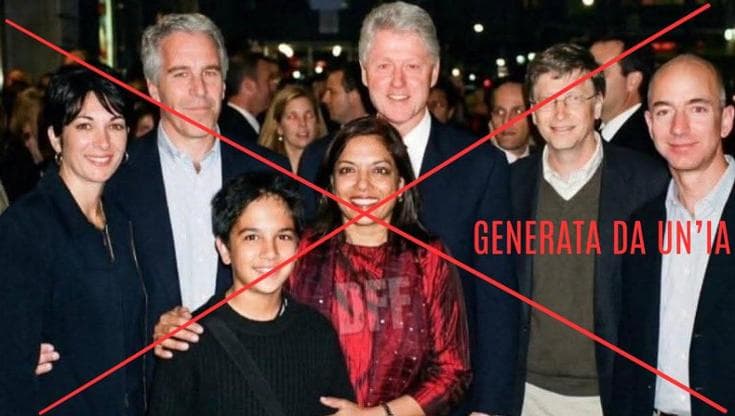

Epstein e il primo cittadino di New York, la vicenda di un’immagine generata da IA e il suo smascheramento.

Tra i documenti resi accessibili dal Dipartimento di Giustizia degli Stati Uniti, che contano circa 3,5 milioni di file, vi è anche un’email inviata nel 2009 da Peggy Siegel, un’associata di Jeffrey Epstein.

Nel messaggio viene menzionato un after party tenutosi in occasione della proiezione del film Amelia, diretto dalla cineasta indiana Mira Nair, al quale avrebbero partecipato, oltre alla regista, anche Jeff Bezos, fondatore di Amazon, e l’ex presidente degli Stati Uniti Bill Clinton.

L’origine della foto falsa

Quella email e il contesto in essa descritto hanno ispirato un profilo satirico attivo su X a creare un’immagine generata tramite intelligenza artificiale.

La foto falsa raffigura Mira Nair con suo figlio – l’attuale sindaco di New York Zohran Mamdani – quando era bambino. Intorno a loro sono presenti Epstein, Maxwell, Clinton, Bezos e Bill Gates.

La scena è ambientata all’aperto, in strada, e richiama visivamente un evento pubblico, come una prima cinematografica o un incontro legato al mondo del cinema. L’account satirico ha corredato la pubblicazione del falso scatto con la frase: “Trucchi del mestiere per diventare un politico di successo in America”.

Sull’immagine è visibile in trasparenza il marchio “DFF”, che rimanda all’account satirico che l’ha creata.

Una semplice verifica della fonte, su X, permetterebbe di risalire all’origine del contenuto e di confermare che si tratta di un profilo che, come affermato nella propria biografia, ironizza sia sulla sinistra che sulla destra attraverso video e meme “di alta qualità” realizzati con l’ausilio dell’intelligenza artificiale.

Questo aspetto fornisce un contesto chiaro che permette di inquadrare l’immagine come un controverso contenuto satirico. Poiché è in grado di generare disinformazione.

Il supporto dei complottisti

L’immagine in questione è stata interpretata da alcuni come autentica e riproposta come se avesse un fondamento reale. Tra questi, Alex Jones, noto conduttore radiofonico statunitense per la sua diffusione di teorie del complotto e le sue posizioni di estrema destra, ha colto l’occasione.

In un post su X, Jones ha presentato l’immagine come una notizia dell’ultima ora, affermando che nuovi documenti legati a Epstein collegherebbero direttamente Zohran Mamdani e sua madre al criminale condannato per abusi sessuali, alla sua collaboratrice e a Gates, Clinton e altre figure pubbliche.

A sostegno di tali affermazioni, Jones ha utilizzato proprio l’immagine generata dall’account satirico, contribuendo alla sua diffusione sui social.

Come riconoscere una foto generata dall’IA?

Questo caso solleva una questione più ampia: in assenza di un marchio come quello visibile sulla foto falsa di cui trattiamo, come sarebbe stato possibile accertare l’autenticità di un’immagine di questo genere?

La fotografia appare tecnicamente convincente. Le mani dei soggetti risultano complete e proporzionate, senza anomalie nel numero delle dita, spesso considerate un indicatore rivelatore delle immagini generate dall’IA.

Anche le persone sullo sfondo sembrano credibili e presentano dettagli coerenti con l’epoca e con la tecnologia utilizzata per catturare la scena, incluso il tipico effetto degli occhi rossi causato dal flash nelle foto notturne della fine degli anni Duemila.

La prima incongruenza

Dal punto di vista anagrafico, i protagonisti sembrano corrispondere all’età che avrebbero avuto nel 2009.

L’unica incongruenza evidente riguarda Zohran Mamdani che, nato nel 1991, all’epoca avrebbe avuto circa diciotto anni, mentre nell’immagine è rappresentato come un bambino.

Questo scarto temporale rappresenta un primo elemento dissonante e introduce un dubbio legittimo sulla veridicità dello scatto.

Come funziona l’IA generativa

Per comprendere come vengano realizzate immagini di questo tipo, è utile considerare il punto di vista di chi le produce. Gli autori conoscono il funzionamento dei modelli di intelligenza artificiale generativa e sanno che, per ottenere una fotografia credibile ambientata in un’epoca specifica, i soggetti devono apparire coerenti con il loro aspetto in quel periodo.

Bezos, Gates, Clinton, Epstein, Maxwell e Mira Nair vengono quindi rappresentati con tratti compatibili con il loro aspetto attorno al 2009.

Essendo personaggi pubblici, esiste un’ampia documentazione fotografica risalente a quegli anni. È plausibile che l’autore abbia utilizzato immagini d’archivio, scatti singoli dei vari soggetti, per fornire al modello di intelligenza artificiale riferimenti visivi coerenti.

A partire da questi materiali, attraverso un prompt testuale, è stato sicuramente richiesto al sistema di generare una scena unica: una fotografia di gruppo che includesse tutti i soggetti forniti come riferimento, collocati in un contesto plausibile e coerente. Il risultato è un’immagine realistica, capace di confondersi con un documento autentico.

L’unico soggetto per il quale non esiste una quantità comparabile di immagini pubbliche è Zohran Mamdani da bambino.

Nella fase della sua vita in questione, non era una figura pubblica e la disponibilità di fotografie riconducibili a lui è limitata a pochi scatti emersi solo in seguito.

La ricerca su Google

Proprio su questo aspetto si è concentrata la nostra analisi, alla ricerca della “prova” definitiva.

Per verificare quali materiali di partenza potessero essere stati utilizzati, è stata effettuata una semplice ricerca su Google utilizzando parole chiave mirate come “Younger Zohran Mamdani 2009” o “Zohran Mamdani 2009 child”, limitando i risultati alla sezione immagini. Tra i contenuti restituiti compaiono, effettivamente, alcune fotografie che ritraggono Mamdani insieme alla madre quando era bambino.

Uno di questi risultati risulta particolarmente significativo. Nell’immagine, la madre indossa un vestito rosso, mentre il bambino porta una maglia nera e una borsa a tracolla: gli stessi abiti visibili nell’immagine generata con l’intelligenza artificiale.

La foto che abbiamo trovato, riconducibile agli anni Duemila, è autentica: è stata recentemente pubblicata anche da un giornale rispettato e accreditato come The Telegraph, in un articolo dedicato a immagini private dell’attuale sindaco di New York.

La corrispondenza visiva degli abiti di Mamdani e Nair suggerisce che quello scatto possa aver costituito uno dei materiali di partenza utilizzati per la creazione dell’immagine artificiale, con il ragazzo e la madre riposizionati in una posa differente e inseriti in una scena pubblica.

La prova decisiva

Tuttavia, la foto originale, in cui sono presenti solo Mamdani e la madre, non elimina ogni “dubbio”: la presenza di transenne e l’ambientazione notturna rafforzano l’idea di un evento ufficiale, come una prima cinematografica.

Su un piano teorico, questo scenario appare compatibile con il contenuto dell’email del 2009 rinvenuta nei documenti legati a Epstein e con il contesto evocato dall’immagine. In astratto, si potrebbe persino supporre che si tratti di uno scatto della stessa serata.

Per verificare questa ipotesi, ci siamo concentrati su una delle più grandi banche dati fotografiche al mondo, Getty Images.

Effettuando una ricerca per nome di Mira Nair e consultando gli scatti più datati, emergono fotografie che la ritraggono proprio insieme al figlio in una situazione pubblica, con gli stessi abiti presenti nell’immagine che abbiamo trovato su Google.

La prova definitiva, quindi, è fornita dai metadati ufficiali: Getty certifica la data degli scatti al 14 giugno 2004. Le immagini documentano la presenza di madre e figlio a una proiezione del film Fahrenheit 9/11.

Si tratta quindi di un evento differente, collocato cinque anni prima rispetto al 2009 e privo di qualsiasi legame con il contesto evocato dall’email associata a Epstein.

Questo riscontro consente di escludere in modo definitivo l’ipotesi che l’immagine “di gruppo” circolata online, con Epstein e Maxwell, rappresenti una fotografia autentica della stessa occasione.

L’importanza delle fonti

Il confronto con archivi fotografici certificati dimostra che la scena è stata ricostruita artificialmente a partire da materiali reali, decontestualizzati e riassemblati.

Il caso illustra come, per smascherare immagini generate dall’intelligenza artificiale e diffuse come documenti autentici, sia necessario combinare strumenti classici del giornalismo, come il fact checking e la consultazione delle fonti, con una conoscenza di base dei meccanismi dell’IA generativa.

In un contesto informativo sempre più affollato di contenuti sintetici, è su questo terreno che si gioca una parte rilevante della distinzione tra informazione verificata e disinformazione.

I commenti sono chiusi.