Le grandi aziende tecnologiche sotto scrutinio: aumento delle azioni legali

Big Tech sotto pressione: boom di cause legali

Social network sotto accusa: dalla class action italiana al fronte globale contro le Big Tech

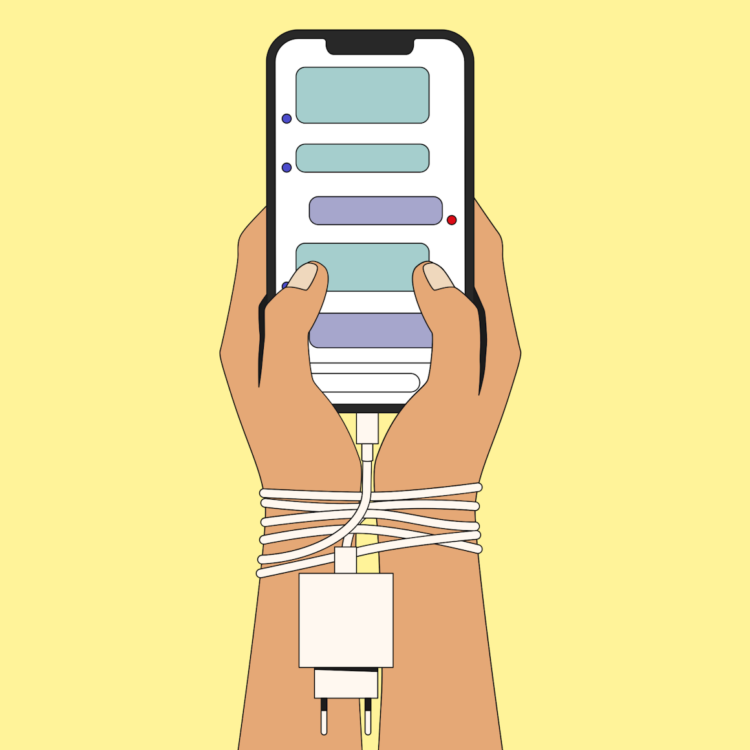

La responsabilità dei social network non è più solo un argomento di discussione pubblica, né un tema limitato alle aule di governo. È diventata, di fatto, una questione da tribunale. Il segnale più chiaro di questo cambiamento proviene da un insieme di azioni legali che, tra Italia, Europa e Stati Uniti, stanno ridefinendo il contesto giuridico e politico in cui operano le piattaforme digitali delle Big Tech.

Al centro delle contestazioni figura in particolare l’influenza delle piattaforme sui minori e il ruolo degli algoritmi nella loro interazione online.

Rimane però un interrogativo sempre più difficile da ignorare: fino a che punto le piattaforme possono essere ritenute responsabili per gli effetti che i loro sistemi generano sugli utenti, in particolare sui più giovani?

In Italia, il caso più significativo è quello avviato da associazioni di famiglie e genitori, tra cui il Moige, che hanno dato inizio a un’azione collettiva contro Meta e TikTok.

Il procedimento, che ha già programmato un passaggio cruciale con l’udienza fissata a Milano, rappresenta uno dei primi casi in Europa in cui non si contestano solo contenuti o episodi isolati, ma l’architettura stessa delle piattaforme. Le accuse si concentrano su tre aspetti fondamentali.

Il primo riguarda l’accertamento dell’età, considerato inefficace nella pratica quotidiana. Il secondo si riferisce alle funzionalità di design dell’interfaccia, come lo scrolling infinito e la riproduzione automatica dei video. Il terzo, probabilmente il più delicato, concerne la struttura degli algoritmi, accusati di promuovere un uso prolungato e potenzialmente compulsivo dei social.

Non si tratta quindi di una semplice contestazione di tipo etico o sociale. L’impostazione della causa si fonda su un piano giuridico ben definito: la responsabilità industriale del design digitale. Tuttavia, il caso italiano non può essere analizzato in modo isolato.

Negli ultimi mesi, infatti, la questione della responsabilità delle piattaforme digitali ha acquisito un’importanza centrale anche a livello europeo. L’Unione Europea ha già istituito un quadro normativo particolarmente avanzato, in particolare con il Digital Services Act, che impone obblighi rigorosi in materia di trasparenza algoritmica, gestione dei contenuti e protezione dei minori.

A questo si affianca il GDPR, che rafforza la protezione dei dati personali e introduce ulteriori vincoli per le piattaforme. Tuttavia, il passaggio decisivo non è soltanto di natura normativa. È anche di tipo giudiziario. Sempre più associazioni di genitori in Europa stanno considerando azioni legali coordinate, prendendo come riferimento proprio l’esperienza italiana.

In questo contesto si inserisce anche la European Parents Association, che rappresenta oltre 150 milioni di famiglie e ha aperto alla possibilità di iniziative parallele in diversi Paesi.

Ora il focus non è più solo sulla protezione dei minori, ma sulla creazione di un settore comune europeo in grado di influenzare le Big Tech anche attraverso il contenzioso legale.

Stati Uniti, il fronte più avanzato sul piano giudiziario

Se in Europa il fenomeno è in fase di sviluppo, negli Stati Uniti la situazione è già più evoluta. Diverse cause civili e collettive hanno coinvolto negli ultimi anni piattaforme come Meta, Google e altri attori del settore.

Alcune sentenze e procedimenti hanno iniziato a riconoscere la possibilità che i sistemi algoritmici contribuiscano in modo significativo a problemi come la dipendenza digitale, l’ansia, la depressione e l’isolamento sociale tra i giovani.

Nello specifico, alcune delle azioni legali avviate contestano il modello di business delle piattaforme, basato sulla raccolta, analisi e monetizzazione dei dati personali: attraverso la progettazione mirata dei loro algoritmi.

Si sostiene che le aziende mantengono un sistema di manipolazione e dipendenza che raccoglie e analizza informazioni personali, estremamente delicate e intime, dei loro utenti.

Il punto non è tanto l’ammontare dei risarcimenti, quanto il principio giuridico che si sta affermando: le piattaforme non vengono più considerate soggetti neutri, ma attori industriali responsabili delle conseguenze derivanti dai propri prodotti digitali.

Una questione economica oltre che giuridica

Dietro questo cambiamento si cela anche una grande questione economica. Il modello di business dei social network si fonda infatti sulla monetizzazione dell’attenzione: più tempo gli utenti trascorrono sulle piattaforme, maggiore è il valore pubblicitario che ne deriva.

È proprio su questo punto che si concentra una parte crescente delle contestazioni: gli algoritmi non sarebbero semplicemente strumenti di organizzazione dei contenuti, ma meccanismi progettati per incrementare la permanenza online degli utenti.

Questo modello, che ha garantito per anni una crescita esponenziale del settore, è ora sotto pressione. Le azioni legali, infatti, non si limitano a chiedere risarcimenti o modifiche marginali, ma mettono in discussione l’intero equilibrio economico su cui si basa l’economia delle piattaforme.

Sul fronte politico, la questione ha assunto un’importanza crescente anche a livello europeo. Gli organismi competenti dell’UE stanno intensificando il controllo sulle grandi piattaforme digitali, dando priorità alla protezione dei minori e alla necessità di rendere più trasparenti i meccanismi sottostanti.

Contemporaneamente, molti governi stanno considerando misure più restrittive per l’accesso dei giovani ai social. Come, ad esempio, controlli più severi sull’età e sulle soglie anagrafiche.

Il dibattito, però, non è uniforme. Se da un lato cresce la pressione per una regolamentazione più rigorosa, dall’altro le piattaforme continuano a sostenere di aver già introdotto strumenti di sicurezza e controllo parentale adeguati.

Il nodo centrale: chi è responsabile degli effetti degli algoritmi?

<pAl centro di tutto rimane una questione ancora irrisolta: la responsabilità degli algoritmi. Per anni i social network hanno sostenuto la tesi della neutralità tecnologica, secondo cui le piattaforme sarebbero semplici infrastrutture, mentre il contenuto e l'uso sarebbero responsabilità degli utenti.

Le azioni legali in corso, tuttavia, rovesciano questo paradigma. L’attenzione si sposta dalla singola interazione al design complessivo del sistema: notifiche, suggerimenti automatici, feed infiniti, sistemi di ricompensa psicologica.

È proprio questa architettura, secondo le accuse, a trasformare i social network in strumenti capaci non solo di ospitare contenuti, ma di orientare comportamenti.

Dalla causa italiana promossa dal Moige alle azioni legali negli Stati Uniti, passando per il crescente coinvolgimento delle istituzioni europee, emerge un quadro sempre più definito: il rapporto tra società e piattaforme digitali sta entrando in una nuova fase.

Non si tratta più solo di regolamentare i contenuti o di correggere abusi singoli. La sfida riguarda la struttura stessa dell’economia digitale e come gli algoritmi influenzano il comportamento umano.

Al di là degli aspetti finanziari, le sentenze contro Meta e Alphabet potrebbero ridefinire la responsabilità delle aziende tecnologiche in merito al benessere emotivo dei propri utenti. Alcuni esperti paragonano questo momento alle sentenze degli anni ’90 che hanno trasformato l’industria del tabacco, quando venne dimostrato che le aziende avevano celato informazioni sugli effetti dannosi del consumo.

Sebbene quelle sentenze non abbiano portato al divieto del tabacco, hanno comunque indotto normative più severe e maggiori restrizioni a tutela dei consumatori.

Questo cambio di prospettiva si riflette già nelle politiche pubbliche orientate alla protezione dei minori. Nel 2025, l’Australia è diventata il primo Paese a vietare l’uso dei social media ai minori di 16 anni, creando un precedente a livello internazionale. Da allora, nazioni come Spagna, Francia e Portogallo hanno adottato o stanno considerando misure simili. Anche in Messico alcuni governi statali hanno iniziato a esplorare iniziative in tal senso.

Da parte loro, l’Unione Europea e il Brasile hanno optato per normative incentrate sulla modifica del funzionamento delle piattaforme al fine di renderle più sicure. In pratica, ciò significa imporre alle aziende di integrare misure di protezione fin dalla fase di progettazione dei loro servizi, compresi gli adeguamenti agli algoritmi e alle funzioni principali.

È ancora troppo presto per stabilire se le recenti sentenze costringeranno le aziende tecnologiche a effettuare modifiche sostanziali ai propri prodotti o se stimoleranno l’adozione di normative più rigorose.

Tuttavia, per la prima volta, i tribunali hanno ritenuto le piattaforme responsabili di come il design dei loro prodotti possa danneggiare gli utenti. Si tratta di un territorio giuridico ancora inesplorato.

In questo contesto, le Big Tech si trovano per la prima volta esposte non solo al dibattito politico o alla regolazione normativa, ma a una crescente pressione giudiziaria e coordinata su più fronti.

Una pressione che, giorno dopo giorno, sta trasformando il social network da spazio privato globale a soggetto di responsabilità pubblica e legale.

I commenti sono chiusi.