Neurodiversità e intelligenza artificiale: chi replica chi?

Leggi in app

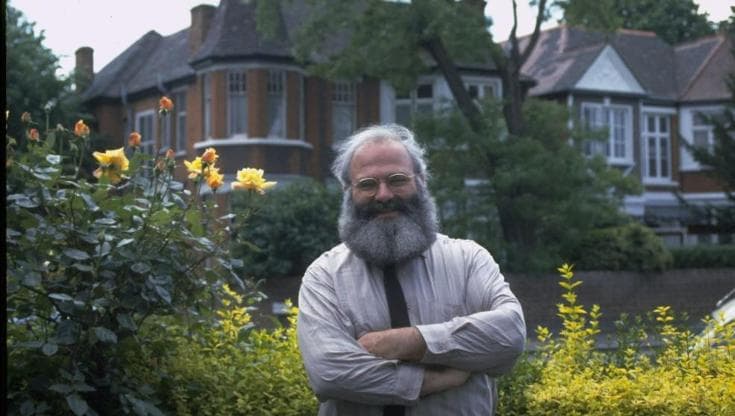

Oliver Sacks. Il neurologo fu tra i primi a trattare come modi diversi di essere nel mondo condizioni neurologiche che venivano considerate deficit.

Nel 1974, il neurologo Oliver Sacks iniziò a pubblicare i suoi casi clinici straordinari: pazienti con condizioni neurologiche che il sistema sanitario considerava deficit, e che lui interpretava invece come modi alternativi di esistere nel mondo, con le loro perdite ma anche con abilità che la cognizione tradizionale non possedeva. Ci vollero vent’anni affinché quella visione si trasformasse in un movimento culturale riconoscibile, quello che oggi definiamo neurodiversità. Altri vent’anni passarono prima che le grandi aziende tecnologiche cominciassero a interrogarsi se stessero escludendo sistematicamente dai loro processi di selezione proprio le persone di cui avrebbero avuto maggiore necessità. Oggi, mentre i sistemi di intelligenza artificiale ridefiniscono il significato di elaborare informazioni complesse, quella domanda riemerge con una nuova intensità e una direzione inaspettata: le architetture che stiamo creando presentano, in qualche misura strutturale, somiglianze con alcune forme di cognizione che abbiamo a lungo considerato marginali?

Una convergenza strutturale, non un’analogia superficiale

È fondamentale chiarire immediatamente cosa si intende e cosa non si intende con questa domanda. L’intelligenza artificiale è un sistema matematico-statistico: non possiede esperienza, non ha intenzionalità, né una dimensione emotiva o relazionale. La neurodivergenza è una variazione della cognizione umana, vissuta da individui reali con storie concrete, con le complessità e le sfide che ciò comporta. Mettere sullo stesso piano le due cose sarebbe non solo inaccurato, ma anche offensivo. La questione è più sottile: alcune architetture dell’IA mostrano caratteristiche funzionali che, se osservate in un essere umano, sarebbero collegate a stili cognitivi neurodivergenti. Non perché l’IA sia neurodivergente, ma perché quelle caratteristiche funzionali, che il pensiero neurotipico dominante ha a lungo considerato marginali o problematiche, si rivelano particolarmente idonee all’elaborazione di sistemi complessi.

I sistemi IA avanzati eccellono nella ricerca di schemi in ampi volumi di dati, nella creazione di modelli coerenti, nell’individuazione di relazioni non immediatamente evidenti, nella preferenza per la struttura logica rispetto all’interpretazione contestuale e sociale. Chi opera nel campo della neurodiversità riconosce in questo elenco alcune delle caratteristiche che la ricerca associa, tra l’altro, a profili dello spettro autistico: attenzione ai dettagli, sistematicità, elaborazione locale prima di quella globale, ricerca di coerenza interna. Non è una coincidenza da cui trarre conclusioni affrettate. È una convergenza funzionale che solleva una domanda culturale significativa: se queste caratteristiche sono ora al centro delle architetture più potenti mai costruite dall’umanità, perché continuiamo a progettare ambienti di lavoro che le penalizzano nelle persone?

Il vantaggio competitivo che non sapevamo di avere

Robert Austin e Gary Pisano, in un articolo diventato un punto di riferimento nel dibattito manageriale internazionale pubblicato su Harvard Business Review nel 2017, documentavano come aziende come SAP, Hewlett-Packard Enterprise e Microsoft avessero riformato i propri processi di selezione per includere talenti neurodivergenti, registrando in cambio aumenti di produttività, miglioramenti della qualità, incrementi nelle capacità innovative e maggiore coinvolgimento dei dipendenti. La tesi di Austin e Pisano era che il problema non risiedesse nelle persone, ma nei sistemi di selezione: i colloqui tradizionali, con le loro richieste implicite di fluidità sociale e adattabilità comportamentale immediata, escludevano sistematicamente individui con competenze rare e preziose, semplicemente perché quelle competenze non corrispondevano al profilo neurotipico atteso.

Quello studio risale al 2017. Da allora, il contesto è cambiato in modo radicale. L’intelligenza artificiale ha reso centrali nei processi aziendali esattamente le capacità che Austin e Pisano descrivevano come punti di forza dei profili neurodivergenti: riconoscimento di schemi, attenzione ai dettagli, coerenza logica, pensiero sistematico. Le organizzazioni che per anni hanno selezionato per la fluidità sociale si trovano oggi a dover integrare sistemi IA che producono output strutturati e complessi, e scoprono di non avere abbastanza persone in grado di interpretarli con la profondità necessaria. Il paradosso è chiaro: si sono dotate della tecnologia che amplifica le caratteristiche cognitive che avevano escluso.

Cosa cambia nella pratica organizzativa

La convergenza tra IA e valorizzazione della diversità cognitiva non è solo un tema culturale: ha implicazioni operative immediate. I processi di selezione basati su colloqui non strutturati, su valutazioni della fluidità comunicativa, su simulazioni di situazioni sociali complesse, continuano a discriminare candidati che potrebbero essere i migliori interpreti e validatori di sistemi IA avanzati. Le valutazioni delle performance costruite attorno a parametri di visibilità, proattività relazionale e adattamento rapido al contesto rischiano di penalizzare esattamente le persone che lavorano meglio in profondità e con sistemi complessi. I modelli di carriera che premiano la generalità rispetto alla specializzazione profonda rischiano di valorizzare le competenze meno critiche nell’era dei modelli IA.

Costruire team cognitivamente diversi non è più solo una questione di equità, per quanto questa rimanga una ragione sufficiente. È una questione di architettura organizzativa: i team che integrano stili cognitivi diversi sono strutturalmente più robusti di fronte alla complessità, perché coprono angolazioni di elaborazione che un gruppo omogeneo, per quanto brillante, non può affrontare. L’IA amplifica questa dinamica perché produce output che richiedono tipi molto diversi di interpretazione: chi è abile nel riconoscere schemi statistici, chi è esperto nel contestualizzare socialmente, chi è capace di identificare anomalie strutturali. Nessuno di questi stili è superiore agli altri. Insieme sono più potenti di qualsiasi sistema IA.

Il rischio normativo che nessuno sta discutendo

C’è una dimensione di questo tema che il dibattito sulla governance dell’IA sta trascurando. Il Regolamento (UE) 2024/1689 introduce principi di non discriminazione e supervisione umana che hanno una logica chiara: evitare che i sistemi IA riproducano e amplifichino bias esistenti. Ma c’è un rischio speculare che merita attenzione: se i sistemi AI vengono addestrati prevalentemente su dati generati da ambienti neurotipici, e se i criteri impliciti di valutazione delle performance che orientano quei sistemi riflettono standard neurotipici, l’IA rischia di diventare uno strumento che rende lo standard dominante ancora più difficile da contestare, perché lo incorpora in un processo apparentemente oggettivo. La trasparenza che l’AI Act richiede sui sistemi dovrebbe estendersi a una domanda che raramente viene posta: su quali presupposti cognitivi sono stati costruiti i criteri di valutazione che i modelli replicano?

Oliver Sacks sosteneva che i suoi pazienti gli avevano insegnato più sulla mente umana di quanto non avesse appreso in anni di formazione tradizionale, perché le condizioni neurologiche atipiche rendevano visibili meccanismi che la cognizione neurotipica dava per scontati e quindi non esaminava. L’intelligenza artificiale sta compiendo qualcosa di simile: rendendo visibili, attraverso le sue architetture, modalità di elaborazione che il pensiero neurotipico dominante aveva sistematicamente sottovalutato. La questione non è se l’IA stia imitando la neurodivergenza. La questione è se stiamo prestando sufficiente attenzione a ciò che ci sta mostrando.

*Carlo Maria Medaglia è Prorettore per la Terza Missione, l’Innovazione Didattica e l’Intelligenza Artificiale all’Università degli Studi Telematica IUL

I commenti sono chiusi.